Alors que plus de 85% des étudiants déclarent utiliser l’IA (source enquête CGE 2025), la question qui se pose à nous, et par conséquent aux Robots, est la suivante : qu’allons-nous faire de nos outils IA, maintenant que les Agents IA en ont pris le contrôle ? On peut même se demander si nous n’avons pas perdu notre temps à essayer d’en gagner en adoptant des outils trop vite obsolètes.

En quelques mois, nous sommes passés de l’ère du « Chatbot » à l’ère de l’IA agentique avec des systèmes capables de planifier des tâches complexes, d’utiliser des outils externes et d’agir de manière semi-autonome pour soutenir l’apprentissage et la recherche. Une nouvelle révolution débute, à peine avions-nous accepté la précédente !

La bonne nouvelle, c’est que ces agents peuvent être spécialisés selon les problèmes à résoudre ou les missions à mener. Avant, les outils IA étaient très généralistes : il fallait les configurer, les paramétrer et savoir bien prompter pour obtenir quelque chose de précis. Aujourd’hui, les agents simplifient une partie de ce travail en orchestrant les outils et en adaptant les réponses. Mais rien de magique pour autant : ces agents doivent eux-mêmes être conçus, paramétrés et ajustés. En revanche, une fois structurés, ils permettent de déléguer une partie de la complexité opérationnelle. Ils peuvent piloter différents outils, affiner les requêtes et adapter les réponses en fonction du contexte.

Autrement dit, le rôle de l’utilisateur évolue. Il ne s’agit plus seulement de formuler des prompts efficaces, mais de définir un cadre et une logique d’action.

Dans l’enseignement supérieur, on commence à voir émerger quatre grands profils d’agents, chacun élaboré pour un métier précis :

- L’agent tuteur ne donne pas la réponse. Il guide l’étudiant par des questions. Il devient également l’assistant de l’enseignant, préparant des séances de questions / réponses par exemple, comme le propose les solutions de RAISON, une jeune EdTech française.

- L’agent de recherche fait ce que personne n’a vraiment le temps de faire : lire, croiser et vérifier. Il synthétise des sources académiques et signale les contradictions.

- L’agent administratif s’occupe de ce qui épuise les équipes : les mails de relance, les dossiers administratifs…

- L’agent d’évaluation ne remplace par les jugements de l’enseignant, il lui évite de rédiger quarante fois le même feedback. Chaque étudiant reçoit un retour personnalisé, comme avec les solutions proposées par Semantikmatch, start-up française, et dont nous avons interrogé le co-fondateur et CEO Stéphane Ureña.

Contrairement aux outils de 2023, les agents de 2026 sont ainsi spécialisés.

Mais au-delà de l’agent individuel, nous en sommes désormais à créer de véritables systèmes agentiques. Les systèmes d’IA agentique utilisent des agents IA pour agir de manière proactive dans des limites prédéfinies, sans nécessiter d’intervention humaine à chaque étape. Ils peuvent itérer et expérimenter pour atteindre des objectifs et accomplir des tâches, même dans des scénarios flous. Grâce à leurs connaissances et à leur mémoire, ils peuvent apprendre et s’améliorer à partir d’expériences passées. Ces systèmes combinent aussi régulièrement plusieurs modèles d’IA, en les optimisant pour certaines tâches.

Impressionnant ! Ces systèmes sont également désignés par une analogie avec le monde animal, puisque l’on parle aussi d’essaim d’agents IA. Originellement le « swarm » ou « essaim » réunit plusieurs agents qui collaborent : par exemple, l’un cherche les sources, l’autre vérifie les faits, un troisième rédige la synthèse. Plus pertinent, ce workflow agentique réduit drastiquement les erreurs ou hallucinations, et permet des tâches de recherche, estimées jusqu’au niveau doctorat dans certains cas.

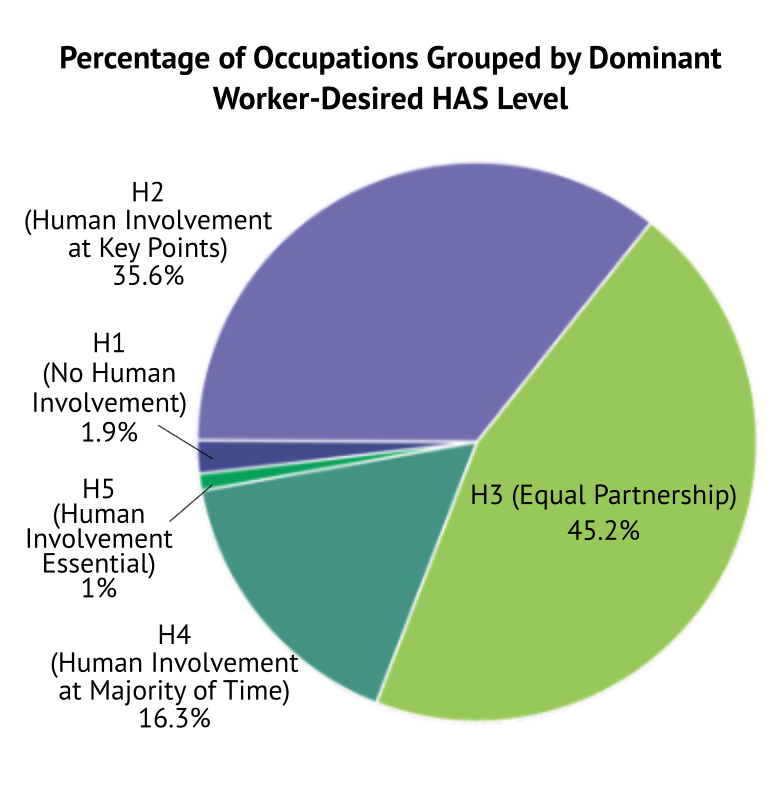

Une étude publiée par le Stanford University SALT Lab révèle que les humains souhaitent majoritairement un partenariat équitable.

Source : Future of Work with AI Agents, Stanford University Social and Language Technologies Lab

Alors quelles règles faut-il suivre pour réussir à maintenir ce fragile équilibre ?

- Avant tout, on s’accordera à préserver le rôle clé attribué à l’humain : la prise de décision finale. Ainsi, l’agent ne doit jamais prendre de décision finale (notation, admission) sans validation humaine. Il doit agir comme un copilote, augmentant la capacité de l’enseignant sans le remplacer.

- Autre principe majeur tant pour les enseignants que pour tous, on ne définit pas l’outil avant l’objectif. Autrement dit, s’il s’agit par exemple d’imaginer un agent d’aide à la rédaction, l’agent IA doit être configuré pour critiquer le plan de l’étudiant et non pour écrire à sa place.

- Le respect de l’IA Act exige transparence et explicabilité. Son article 50 impose notamment d’informer les personnes quand elles interagissent avec une IA et de signaler les contenus manipulés par l’IA. Là encore, il faut fixer des règles claires sur l’intégrité académique et l’utilisation des données.

- Les établissements peuvent proposer des cursus intégrant la littératie en IA, qui inclut aussi la compréhension de ses limites, de ses biais, de ses impacts et des bons usages selon le contexte. En effet, les étudiants, mais aussi les enseignants, doivent développer leur capacité à comprendre, utiliser et évaluer de façon critique les systèmes d’intelligence artificielle. Il ne s’agit plus d’une option.

- Enfin, l’enjeu relatif aux données doit être réévalué. Anonymiser et veiller à respecter des critères stricts d’inclusion doit être une exigence incontournable pour tout ce qui relève de l’éducation des futures générations.

Dans ces conditions, on comprend que nombre de métiers sont déjà touchés par l’arrivée des agents IA. Les enseignants et les personnels constatent déjà des impacts forts sur les tâches routinières et les flux de travail. L’intelligence artificielle change la façon dont les personnels répartissent leur temps. Cela pousse les établissements à repenser les rôles et la charge de travail de chacun. Les gouvernances doivent alors accompagner les enseignants et les personnels par la formation. Nous en sommes aujourd’hui à apprendre comment l’automatisation opérationnelle peut libérer du temps et fluidifier le travail collectif au sein des établissements. Des agents IA orientés opérations, qui automatisent de longs flux d’emails ou de gestion administrative, montrent déjà comment réduire le temps de traitement des tâches répétitives. Ce temps libéré est une opportunité réelle, mais encore faut-il savoir quoi en faire. La question de savoir à quoi et à qui ce temps profite reste ouverte, et c’est précisément aux gouvernances de s’en emparer.

Un autre enjeu majeur en faveur de l’adoption rapide des agents IA, est celui de l’amélioration de l’expérience étudiante.

Il semble que les agents IA offrent des cas d’utilisation clairs qui améliorent directement les résultats des étudiants. Le tutorat personnalisé qui s’adapte aux besoins des étudiants et fournit des exercices ciblés en est un exemple. Les revues de littérature automatisées qui accélèrent la recherche et libèrent du temps pour l’analyse en est un autre. Par ailleurs, certains outils de conception de cursus suggèrent des mises à jour basées sur la littérature récente et les retours étudiants, pour une meilleure personnalisation. En bref, les agents dans l’enseignement supérieur sont des assistants pratiques pour l’enseignement comme pour la recherche.

Côté recherche, des assistants de recherche multi-agents effectuent des recherches bibliographiques et synthétisent les résultats. Un dispositif d’automatisation ciblée facilitant l’indispensable travail de veille fait ainsi gagner un temps précieux aux doctorants comme aux chercheurs qui peuvent par exemple recevoir chaque matin un e-mail contenant les recherches effectuées par leur agent.

Dans certaines écoles d’ingénieurs comme Polytechnique, l’enseignement de l’IA monte en puissance avec une centaine d’heures dédiées intégrées au cursus ingénieur dès 2024-2025. La question commence à se poser : l’agent IA a-t-il vocation à devenir un outil d’ingénierie à part entière ? Ce qui se dessine, c’est un possible glissement des compétences attendues : moins écrire du code soi-même, davantage orchestrer les agents qui le produisent. (https://www.polytechnique.edu/actualites/lx-accueille-le-volet-scientifique-du-sommet-pour-laction-sur-lia)

À l’opposé, dans des établissements comme Sciences Po ou Sorbonne Nouvelle, l’approche est radicalement différente. L’IA n’est pas là pour « donner la réponse », mais pour « complexifier la pensée ». Les étudiants font des agents IA leurs premiers contradicteurs. Par exemple, un étudiant soumet son plan de dissertation à un agent configuré pour détecter les biais cognitifs, les manques de nuances ou pour opposer une théorie adverse, comme confronter une vision structuraliste à une analyse libérale.

On retrouvera un usage classique en matière d’analyse de documents, mais, plus innovant, l’étude même de l’agent IA. On apprend alors à interroger ses limites pour mieux comprendre ses biais idéologiques et linguistiques. À Sciences Po, par exemple, un cours intitulé « Decoding Biases in AI » et un « laboratoire d’autopsie des algorithmes » permettent aux étudiants d’étudier concrètement comment les algorithmes influencent notre vision du monde. (https://www.sciencespo.fr/ecole-affaires-publiques/en/news/lessons-learned-course-decoding-biases-artificial-intelligence/)

Pour autant, et à mesure que les agents IA se perfectionnent et se spécialisent, on observe en 2026, un début de convergence : les ingénieurs sont formés à l’éthique des algorithmes (empruntant aux SHS), tandis que les étudiants en SHS apprennent les bases de la logique computationnelle pour ne pas être « subis » par les outils qu’ils utilisent.

Les exemples rencontrés par les Robots montrent en définitive que l’IA et ses agents, qui constituent une forme de personnification de l’IA, ne conduisent en rien à une uniformisation des modèles ni des structures d’enseignement. C’est sans nul doute une angoisse persistante de l’humain face aux machines, déjouée aujourd’hui par de très nombreux établissements du supérieur. Les Robots vous proposent quelques exemples intéressants à suivre de près.

1 – Le modèle de la « plateforme souveraine » de University of Michigan (États-Unis)

L’Université du Michigan (U-M) a fait le choix de construire sa propre infrastructure et d’y héberger différents modèles d’IA pour les rendre accessibles à ses étudiants, enseignants et personnels.

- L’outil phare : U-M Maizey. C’est un agent IA « no-code » mis à disposition de l’ensemble de la communauté (enseignants, personnels et étudiants).

- Fonctionnement : un professeur de droit peut, en quelques clics, « nourrir » son instance Maizey avec 20 ans d’archives de jurisprudence spécifique. L’agent devient alors un expert du corpus de ce cours précis, évitant les hallucinations basées sur des données externes généralistes.

Résultat : En 2026, Maizey est utilisé pour créer des assistants de recherche personnalisés pour les doctorants, capables de surveiller la publication de nouveaux articles dans leur niche et d’en faire un résumé critique chaque matin.

2 – Le modèle de la « pédagogie à deux voies » proposé par University of Sydney (Australie)

Face à l’omniprésence des agents, l’université de Sydney a radicalement transformé son système d’évaluation avec l’approche « Two-Lane Assessment » (pédagogie à deux voies).

- Voie 1 (sécurisée) : examens en présentiel, sans IA ou avec une IA très contrôlée, pour vérifier l’acquisition des connaissances fondamentales (le « socle »).

- Voie 2 (ouverte & agentique) : les étudiants sont encouragés à utiliser des essaims d’agents (swarms) pour résoudre des problèmes complexes.

Cas pratique en business : Les étudiants interagissent avec une simulation composée de plusieurs agents représentant différents « stakeholders » (un client difficile, un directeur financier rigide, un ingénieur technique). L’étudiant doit naviguer entre ces agents IA, chacun ayant des objectifs contradictoires, pour faire avancer son projet. L’évaluation porte sur la capacité de l’étudiant à orchestrer ces interactions.

3 – Le modèle du « tuteur adaptatif national » fournit par l’Université de Singapour (NUS)

Singapour traite l’IA comme une infrastructure publique. Leur système Adaptive Learning System (ALS) a évolué en 2026 pour devenir un réseau d’agents tuteurs.

- Feedback hyper-personnalisé : l’agent « annotated feedback assistant » analyse les copies de mathématiques ou de langues non pas pour donner une note, mais pour identifier le « blocage conceptuel » précis de l’étudiant.

- Le passage de témoin : si l’agent IA détecte qu’un groupe d’étudiants bute sur le même concept après trois tentatives, il génère automatiquement une alerte à l’enseignant humain avec un résumé des erreurs types, permettant au professeur de faire une intervention « chirurgicale » en classe le lendemain.

Ces exemples divers montrent que de nombreuses routes se dessinent pour l’adaptation des pédagogies aux nouveaux outils, désormais devenus de véritables assistants. Partout dans le monde, des voies nouvelles nous dirigent vers la connaissance et l’apprentissage de compétences plus complexes. Les agents IA vont-ils accélérer nos trajectoires sans nous dévier de la réalité des savoirs ? Comment les intégrer sans renoncer au contrôle humain ou à l’esprit critique, autant d’atouts dont sont pourvus tous les acteurs du monde académique, tous les chercheurs et idéalement, tous les

apprenants ?

En définitive, la découverte des agents IA est seulement le début d’un long voyage. Pour l’instant, nous sommes encore aux commandes du vaisseau. A nous de rester maîtres à bord et de conserver les fonctions cognitives essentielles à notre humanité, en les transmettant aux prochaines générations.

Évitons donc ensemble que ce ne soient les agents IA qui remettent notre monde en question !

Envie de découvrir d’autres articles sur l’enseignement supérieur et la EdTech ? Rendez-vous sur le Blog des Robots !